La doctora Melissa Llauce analiza la naturaleza de la inteligencia artificial, su impacto en las relaciones sociales, la cuestión ética que la acompaña y la innegable necesidad de la presencia y mediación humanas para su uso adecuado.

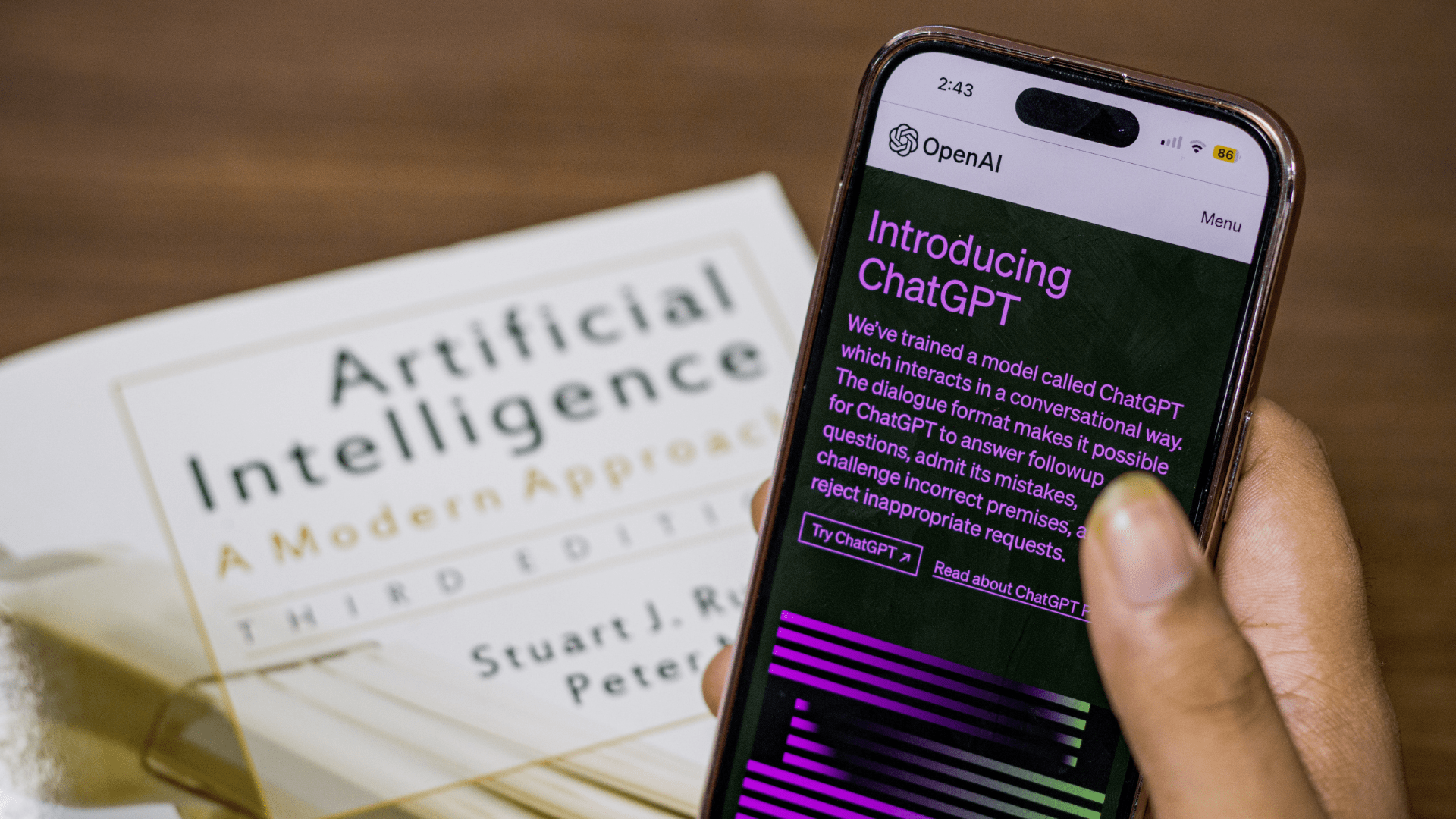

Por Gabriela Hernández. 18 septiembre, 2023. Publicado en Correo, el 18 de setiembre de 2023.Si bien la inteligencia artificial está presente desde hace un tiempo en diversas aplicaciones con las que los usuarios tienen contacto constante, el auge de esta en herramientas como ChatGPT o generadores de imágenes y gráficas como Leonardo AI han hecho más evidente su presencia en las actividades cotidianas.

Un buen resumen original de un libro, un artículo lógico y cohesionado, un emotivo mensaje de disculpas o un completo itinerario de viajes personalizado están -literalmente- a un clic de distancia. Todo esto, en apariencia, sin la intervención de una mente humana que abstraiga, proponga, discierna o matice. Ante el impacto de la inteligencia artificial en cómo las personas viven y se relacionan, surgen numerosas expectativas, desde las más optimistas hasta las más apocalípticas.

La doctora Melissa Llauce, profesora de Filosofía de la Universidad de Piura, analiza la naturaleza de la inteligencia artificial, su impacto en las relaciones sociales, la cuestión ética que la acompaña y la innegable necesidad de la presencia y mediación humanas para su uso adecuado.

¿Cómo entender la inteligencia artificial (IA) en relación con la inteligencia humana?

Lo artificial no es natural, es un artificio, un arte, es una invención humana. No existe sin la persona, que es quien crea. La IA está hecha para imitar solo una o algunas de las facultades de la persona: la abstracción, el juicio, el razonamiento, la resolución de problemas, etc. No imita todos los aspectos de una persona, que también es su cuerpo, sus afectos y una larga lista de elementos que no se pueden emular con una herramienta como la IA.

Las herramientas de la IA nos pueden superar en el conocimiento, en la acumulación de datos y en el procesamiento de estos, pero sabemos que la persona es más que solo esto.

¿Puede ser ética la inteligencia artificial?

La IA no es mala ni buena, sino que su uso dependerá de la acción humana. Es la persona la que es un ser ético, en este sentido, los efectos causados por la IA dependen del buen o mal uso que le dé la persona, así como de las intenciones y los objetivos de quienes la programan. Se la podría programar para tomar ciertas decisiones, basadas en datos almacenados, y estas decisiones podrían corresponderse con la ética, pero siempre es necesaria la intervención humana para valorarlas.

Recordemos que la ética en las personas nos es computable, resiste cualquier reducción a un simple código de conducta. Nuestras acciones son manifestaciones de nuestra individualidad y libertad intrínseca. A diferencia de las máquinas, que pueden ser reprogramadas cuando fallan, los seres humanos podemos adquirir aprendizaje a partir de una desición equivocada, podemos aprender de los errores y mejorar siempre. Para lograrlo necesitamos adquirir hábitos buenos y no es tan sencillo como sucede con las máquinas que bastaría con apagarlas y volverlas a encender, con una nueva programación. Solo las personas podemos distinguir entre el bien y el mal, y reconocer conceptos fundamentales como la dignidad y los valores éticos. Los problemas morales son un terreno exclusivamente humano.

¿Cómo usar éticamente la IA?

Sea en el sector que sea, el empresarial, el educativo, etc., es importante hacerse las siguientes preguntas ante una decisión que implique la tecnología: ¿Cuál es el objeto de mi acción?, ¿qué pretendo conseguir con esta acción?, ¿cuál es mi intención, mi fin?, ¿qué consecuencia puede tener mi acción?

Por ejemplo, ante una decisión empresarial, como un recorte de personal, será necesario ponderar todas las opciones y las consecuencias que este tendría para los empleados afectados. Si un estudiante, por ejemplo, quiere hacer pasar un texto de ChatGPT como propio y si el profesor no lo nota, podrá obtener una buena nota. Pero quien no se está perfeccionando, quien no está aprendiendo realmente, es el estudiante. En este sentido, hay que cuidarse de la robotización de la persona.

¿Cuál es el impacto de IA en nuestras interacciones sociales?

Por naturaleza, somos seres sociales. La IA puede disminuir la concretización de la sociabilidad, pero no la elimina porque siempre necesitamos de la presencia física, corporal, de las personas con las que nos relacionamos; esta presencia es muy importante.

La IA sí que puede potenciar las interacciones sociales, sin duda. En plena pandemia, cuánto nos ayudó. El punto de quiebre siempre estará en cómo usan las personas estas herramientas.

¿Cómo aproximarse a las hipótesis u opiniones más pesimistas sobre la inteligencia artificial?

Las personas, a lo largo de la historia de la humanidad, siempre han tenido épocas apocalípticas. En el siglo anterior, lo apocalíptico eran las grandes guerras. Siempre hay crisis, siempre hay situaciones que nos hacen cuestionarnos sobre el tema humano. Y eso es importantísimo porque nos permite avanzar en nuestro entendimiento sobre cómo nos relacionamos con los distintos retos que enfrentamos como humanidad.

Ahora, nos preocupa cuál es el destino de la persona con el auge de la inteligencia artificial. Hay que recordar que esta está sujeta a leyes mecánicas, reproduce o imita la inteligencia humana, hay un programador, y el aprendizaje de la máquina es computable, hay un comportamiento mecánico y programado. La inteligencia artificial puede tener una predisposición para la acción, pero nunca para la decisión. El gran riesgo de la IA es que las personas la usemos mal.

¿Cree que automatizar los procesos o integrar la tecnología en nuestras decisiones nos puede transformar o cambiar la perspectiva de la ética?

Sí, porque la ética no es de la máquina, es de la persona. Se puede automatizar la toma de decisiones, y puede que estas decisiones, en algún momento, se correspondan con lo que es ético. Pero en la persona, este proceso nunca sucede de manera automática. Es siempre producto de un discernimiento. Por supuesto que se pueden tener referentes, pero esto es completamente distinto a la automatización. Las fórmulas éticas aplicables a absolutamente todo no existen; esta debe atender a las circunstancias de las personas, es decir se circunscribe a un contexto concreto, sin que esto signifique caer en el relativismo, no hay que olvidar que las buenas decisiones tendrán en cuenta la Verdad, el Bien y a los demás.

¿Podría la IA contribuir a la formación de valores éticos en las futuras generaciones?

Hay que recordar, aunque la inteligencia artificial o cualquier cosa creada por el hombre siempre estará sometida a este, las personas podrían crear cosas que vayan en contra de la naturaleza humana porque los seres humanos son libres de dirigir sus acciones, lo cual no significa que toda acción que realizo libremente sea realmente buena.

Para evitar esto, quienes estén a cargo del uso de la IA deben contar con lo que yo llamo la “mochila de virtudes” y, para esto, es necesaria la formación de la persona en hábitos buenos que le preparen, le perfeccionen y tengan en cuenta siempre, como ya lo he mencionado: la verdad, el bien y a los demás. La IA nos proporciona mucho conocimiento, pero hay que tener discernimiento para distinguir lo que es relamente bueno de lo malo.